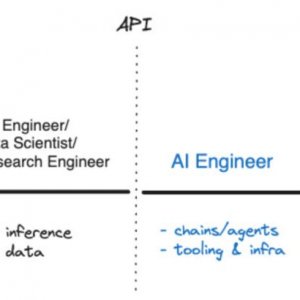

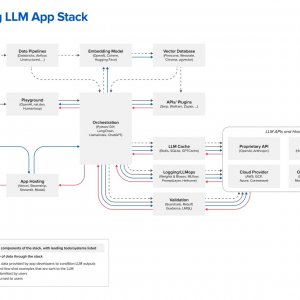

16.08.2023 Экспертиза, Искусственный интеллект, МенеджментWeb3 так не смог переделать экосистему разработчиков, но появляющийся стек больших языковых моделей (LLM) способен адаптировать нативно-облачную разработку к эре ИИ, сообщает портал The New Stack, проанализировавший структуру стека LLM . Экосистема разработчиков приложений с поддержкой искусственного интеллекта начинает созревать после появления за последний год таких инструментов, как LangChain и LlamaIndex. Появился даже термин для разработчиков, ориентированных на ИИ: «AI engineer» («ИИ-инженер»), который, по словам его проповедника Шона @swyx Ванга (Shawn @swyx Wang), является следующей ступенью по сравнению с «prompt engineer» («инженер по подсказкам»). Он создал интересную диаграмму, показывающую, как ИИ-инженеры вписываются в более широкую экосистему ИИ и разработки: #IMAGE_227084# Основной технологией для ИИ-инженера является LLM. LangChain и LlamaIndex не случайно являются инструментами, расширяющими и дополняющими LLM. Но какие еще инструменты доступны этому новому классу разработчиков? Интересную схему стека LLM предлагает венчурный фонд Andreessen-Horowitz (a16z): #IMAGE_227085# Важнейший слой данных Нет необходимости говорить о том, что самое важное в LLM-стеке — это данные. На диаграмме a16z это верхний слой. «Встраивание модели» («embedding model») — это место, где находится LLM. Вы можете выбрать OpenAI, Cohere, HuggingFace или один из нескольких десятков других вариантов LLM, включая все более популярные LLM с открытым исходным кодом. Но еще до того, как вы ...

читать далее.